myCobot 320 AIキット2023でロボットキットをアップグレードしましょう

話

導入

以前発売したAIキット2023については、既にご存知かもしれません。ユーザーの皆様のご要望にお応えして、 myCobot 320 AIキット2023を発売しました。そして今回、この成功体験をmyCobot 320にも応用し、ロボットアームの性能と機能をさらに強化しました。この最新キットは、前モデルの優れた性能を継承するだけでなく、数々の魅力的な新機能も搭載しています。

本稿では、myCobot 320 AI Kit 2023の特徴と利点を詳しく解説します。認識能力、インテリジェントプランニング、経路最適化機能、自己学習機能、適応機能などについて詳しく解説します。さらに、他のインテリジェントデバイスとの統合とリモート制御のサポート、そしてユーザーフレンドリーなインターフェースと操作方法についても解説します。

製品

マイコボット 320 M5/Pi

myCobot 320はmyCobot 280の進化版で、主にメーカーや研究者向けに設計されています。ユーザーのニーズに合わせた二次開発が可能で、パーソナライズされたカスタマイズを実現します。全体的なデザインは精巧に設計され、オールインワン設計となっています。使いやすさ、安全性、経済性という3つの大きなメリットを備え、コストパフォーマンスに優れたロボットアームとなっています。

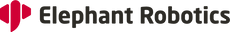

myCobot 320は主に2つのバージョンに分かれており、1つはM5Stackを制御コアとして採用し、もう1つはRaspberry Pi 4Bを制御コアとして採用しています。myCobot 320は、最大荷重1kg、最大動作半径350mm、繰り返し位置決め精度は0.5mm以内です。さらに、12個の標準24V産業用I/Oインターフェースを搭載しており、PLC制御の拡張性を高めることができます。

仕様

myCobot 320 AIキット

myCobot 320 AIキットは、AIキット2023をベースにしたアップデート版です。myCobot 320人工知能キット2023版は、5つの視覚認識アルゴリズム、7つのアプリケーションシナリオ、2つの把持方法を備え、視覚化ソフトウェアをサポートしています。位置決めと把持、自動仕分け、アイテム把持モジュールを統合したエントリーレベルの人工知能キットです。

ここでは、myCobot 320 AI Kit 2023 の特徴と利点を紹介します。

機能紹介

元の機能の継続

myCobot 320ロボットアームAIキットは、AIキット2023の革新的な機能を継承し、ユーザーに卓越したロボットアーム体験を提供します。まず、myCobot 320 AIキット2023は、AIキット2023から5つの認識アルゴリズムを継承しています。様々な物体を認識し、正確に掴むことができます。以下は、5つの認識アルゴリズムの概要です。

5 つの視覚アルゴリズムは次のとおりです。

● 形状認識アルゴリズム

● 特徴点認識アルゴリズム

● ARコード認識アルゴリズム

● 色認識アルゴリズム

● YOLOv5認識アルゴリズム

最初の4つのアルゴリズムは、OpenCVというオープンソースのコンピュータビジョンライブラリをベースにしています。OpenCVをご存知ですか?OpenCVは、画像や動画を処理するための多くのアルゴリズムとツールを提供するオープンソースのコンピュータビジョンライブラリです。Intel Corporationによって開発され、BSDライセンスの下でリリースされたOpenCVは、C++、Python、Javaなど、様々なプログラミング言語をサポートする、広く使用されているコンピュータビジョンライブラリです。OpenCVは、画像・動画処理、顔認識、物体検出、マシンビジョンアプリケーションなど、様々なアプリケーションに使用できます。優れたパフォーマンスと柔軟性を備えたOpenCVは、多くのコンピュータビジョンアプリケーションで好まれるライブラリです。

近年、ディープラーニングと機械学習を組み合わせたアルゴリズムが人気を集めています。YOLOv5はディープラーニングをベースにした物体検出アルゴリズムで、 YOLO(You Only Look Once)に属しています。 シリーズ。その目標は、リアルタイムアプリケーションで使用でき、大規模データセットで学習可能な、効率的で正確な物体検出アルゴリズムを提供することです。YOLOv5は、1枚の画像内の異なる物体を検出し、ラベル付けすることができます。複数の物体を同時に検出し、画像内の各物体の境界ボックス、物体のクラス、信頼度を提供します。

画像に示すように、YOLOv5 はモデルの大規模なトレーニングを通じて素晴らしい結果を達成しました。

新しい機能と革新

私たちは、吸引ポンプやグリッパーといった新しいエンドエフェクタを導入することで、既存の基盤を強化しました。

myCobot Pro シングルヘッド吸引ポンプ

シングルヘッド吸引ポンプの動作原理は、電気モーターを使用して真空を発生させ、大気圧を利用してエンドエフェクタの吸引カップが物体をしっかりと掴めるようにすることです。市販のモジュラー吸引カップと比較して、このデバイスはサイズが大幅に小型化されているため、持ち運びに便利です。

myCobot Proアダプティブグリッパー

新しく追加されたインテリジェントな把持機能には当社のアダプティブ グリッパーの使用が必須となったため、 myCobot Pro アダプティブ グリッパーエンドエフェクターをシステムに組み込みました。

インテリジェントな把握

インテリジェント把持機能は、物体に貼り付けられた2次元コードを用いて、把持すべき位置を特定し、その位置を特定します。その後、物体の幅に基づいて、アダプティブグリッパーの把持範囲を決定します。この機能は、OpenCVの2次元コード認識機能を利用して物体の座標を取得し、ロボットアームによる後続処理に利用します。

以下はデータ処理の疑似コードです。

import cv2

import numpy as np

import zbar

scanner = zbar.Scanner()

img = cv2.imread('image.png')

gray = cv2.cvtColor(img, cv2. COLOR_BGR2GRAY )

thresh = cv2.threshold(gray, 0, 255, cv2. THRESH_BINARY_INV | cv2. THRESH_OTSU )[1]

results = scanner.scan(thresh)

for result in results:

print('タイプ:%s、データ:%s' % (result.type, result.data))

輪郭、階層 = cv2.findContours(thresh, cv2. RETR_EXTERNAL , cv2. CHAIN_APPROX_SIMPLE )

等高線内のcntの場合:

面積 = cv2.contourArea(cnt)

周囲長 = cv2.arcLength(cnt, True )

面積 < 100 の場合:

続く

x, y, w, h = cv2.boundingRect(cnt)

cv2.rectangle(画像, (x, y), (x + w, y + h), (0, 255, 0), 2)

print('オブジェクトの幅: %d、座標: (%d, %d)' % (w, x, y))

cv2.imshow('画像', img)

cv2.waitKey(0)

cv2.すべてのウィンドウを破棄する()

GUIインターフェース

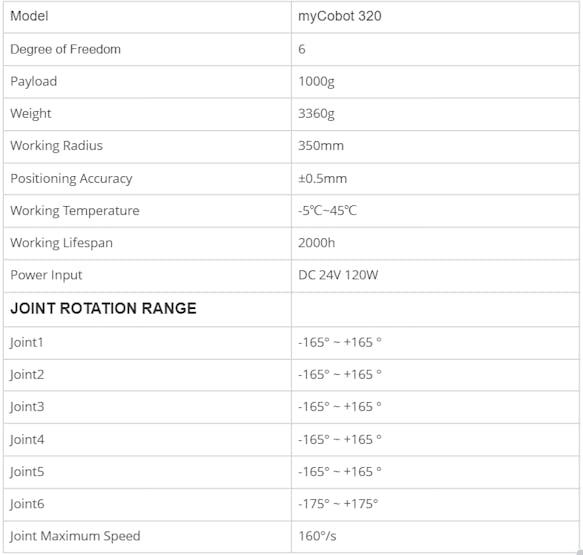

ビジュアルインターフェース

AI ツールキットの機能をユーザーが直感的に理解できるようにするために、次の機能を提供するビジュアル インターフェースを開発しました。

● より直感的な操作

● AIツールキットの機能の理解度の向上

● よりユーザーフレンドリーな体験

使用方法の紹介

PythonでコーディングされたプログラムであるmyCobot 320 AI Kit 2023の環境を構築するには、以下のコンパイル環境が必要です。

● パイソン

● pymycobot

● OpenCV

● YOLOv5

これらのコンパイラをインストールしたら、myCobot 320 AI Kit 2023 の関連コードをダウンロードします。myCobot 320 Pi マシンを使用している場合は、コンパイル環境をインストールする必要はありません。

使用手順

main.pyを実行する

これが私たちのビジュアルインターフェースです。機能と使い方を一つずつご紹介します。

言語を切り替えるにはここをクリックしてください。現在、簡体字中国語と英語がサポートされています。

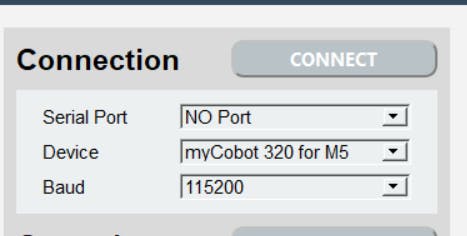

ロボットアームのシリアルポート、ボーレート、デバイスモデルを選択し、コンピューターに接続します。

ここをクリックすると AI キットのカメラが開き、認識アルゴリズムとカメラで撮影した画像が表示されます。

この機能モジュールは、myCobot 320 を制御するために設計されています。

自動モード:このボタンをクリックすると、プログラム全体が自動的に実行されます。

ホミング:カメラが位置特定用の 2D コードをキャプチャしない状態で、ロボット アームを初期位置に戻すように制御します。

認識:カメラで撮影した画像に対してアルゴリズムベースの認識を実行します。(この動作中、ロボットアームは動きません。)

ピック:ロボットアームに吸引・把持動作を指示します。(この動作は認識機能と連携して実行する必要があります。)

配置:掴んだアイテムを配置するために、使用可能な 4 つのビンのいずれかを選択します。

XYオフセット:エンドエフェクタの吸引ポンプ/グリッパーが物体に接触する位置を微調整します。「x」で水平位置、「y」で垂直位置を調整します。

アルゴリズム選択:特徴点認識など、認識に使用するアルゴリズムを選択します。一部のアルゴリズムでは、認識対象となる画像を事前に追加する必要があります。これは、下の「追加」ボタンと「終了」ボタンを使用して行うことができます。

プログラムを正常に実行するには、次の手順に従います。

1. 'main.py' を実行してプログラムを起動します。

2. ロボット アームのモデル、シリアル ポート、ボー レートを選択して接続を確立します。

3. カメラを開きます。

4. 認識アルゴリズムを選択します。

5. 「自動モード」をクリックして AI キットを実行します。

まとめ

この記事では、myCobot 280 AI Kit 2023の拡張およびアップグレードであるmyCobot 320 AI Kit 2023について詳しく紹介しました。この新しいキットは、より強力で柔軟性が高く、インテリジェントなロボットアームソリューションをユーザーに提供します。革新的で強力なインテリジェント把持機能は、ロボットアームの分野における物体の位置決めと把持に不可欠な部分です。この初心者レベルのAIキットは、OpenCV認識アルゴリズム、Pythonプログラミング、ロボットアームの制御原理、順方向および逆方向の運動学、ハンドアイキャリブレーション、エンドエフェクタの使用方法など、ロボットアームの入門原理と機能に関する知識を習得できる多くの学習方向をユーザーに提供します。myCobot 320 AI Kit 2023の導入により、この革新的な製品がユーザーにさらなる可能性と機会をもたらすと信じています。